在全球化競爭與科技自主可控的雙重背景下,國產計算機基礎軟硬件行業正迎來歷史性發展機遇。本報告旨在深度剖析行業現狀、挑戰與未來路徑,探討如何通過技術開發與生態建設,重構中國IT產業生態,筑牢數字經濟發展的基石。

一、行業現狀:從“可用”到“好用”的關鍵跨越

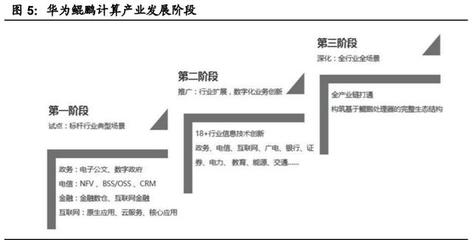

當前,我國在CPU(如龍芯、鯤鵬、飛騰)、操作系統(如麒麟、統信UOS)、數據庫、中間件等基礎軟硬件領域已取得顯著突破,部分產品在黨政、金融、能源等關鍵行業實現規模化應用。與國際領先水平相比,國產基礎軟硬件在性能、生態兼容性、工具鏈完善度等方面仍存在差距,生態碎片化問題較為突出。從“可用”到“好用”,成為行業邁向成熟必須攻克的核心命題。

二、核心挑戰:技術、生態與市場的三重壁壘

- 技術壁壘:高端制程工藝、核心IP(知識產權)、先進架構設計等仍受制于人,底層基礎研究與原始創新能力有待加強。

- 生態壁壘:軟硬件協同優化不足,應用軟件、開發工具、人才體系的匱乏導致生態閉環難以形成。Wintel(Windows-Intel)及AA(Android-ARM)等成熟生態的虹吸效應依然強大。

- 市場壁壘:用戶習慣、遷移成本、以及對現有業務系統穩定性的顧慮,使得市場化推廣面臨阻力。

三、發展路徑:以“技術開發”驅動“生態重構”

- 堅持自主創新,突破核心技術:

- 硬件層面:集中攻關CPU微架構、芯片設計工具(EDA)、先進工藝等,推動異構計算、存算一體等新架構研發。

- 軟件層面:深耕操作系統內核、編譯器、編程語言、基礎算法庫,構建自主可控的軟件根技術體系。

- 協同優化:加強軟硬件協同設計,從指令集、操作系統到應用進行全棧優化,提升整體性能與能效。

- 構建開放共贏的產業生態:

- 標準引領:推動建立基于自主技術的軟硬件接口、協議與兼容性標準,減少內部碎片化。

- 平臺賦能:打造統一的開發者平臺、開源社區與適配認證中心,降低應用移植與開發門檻,吸引海量開發者與ISV(獨立軟件開發商)。

- 產業協同:以龍頭企業為牽引,打通從芯片、整機、操作系統到行業應用的產業鏈,形成“芯片-系統-應用-服務”一體化能力。

- 深化應用牽引,拓展市場空間:

- 以點帶面:持續深化在黨政、關鍵基礎設施領域的滲透,并以此為基礎,向金融、電信、工業互聯網等對安全要求高、價值量大的行業拓展。

- 場景創新:把握云計算、人工智能、物聯網、邊緣計算等新技術浪潮,在新型算力架構與場景中搶占先機,實現彎道超車。

- 培育信心:通過打造標桿案例、提供平滑遷移方案與全方位服務,逐步建立市場對國產技術路線的信任與依賴。

四、未來展望:打造安全、繁榮、引領的IT新生態

重構中國IT產業生態是一項長期而系統的工程。國產基礎軟硬件行業將不再是單一產品的替代,而是以自主技術體系為核心,構建一個從底層硬件、基礎軟件到上層應用完全打通、安全可控、充滿活力的新生態。這不僅關乎產業鏈安全,更是中國從IT大國邁向IT強國,在全球科技競爭中占據戰略制高點的必由之路。

通過持續的技術開發投入、堅定的生態建設決心與靈活的市場策略,國產計算機基礎軟硬件行業有望在不久的將來,真正實現從技術追趕到局部領先,再到生態引領的歷史性跨越,為數字中國建設提供堅實底座,并為全球計算產業貢獻中國方案與中國智慧。